Llama 4 обгоняет конкурентов в 2025 году

Прорыв в мультимодальности: Llama 4 — новое поколение открытых моделей

Meta* представила семейство Llama 4 — первые нативно мультимодальные модели с открытыми весами1, которые объединяют понимание изображений, видео и текста в единой архитектуре. Это не просто очередной шаг в развитии ИИ, а настоящая революция, которая делает технологии доступнее и мощнее для всех.

Ключевые модели Llama 4: Scout, Maverick и Behemoth

Llama 4 Scout

Scout — это компактная модель с 17 миллиардами активных параметров (из 109 миллиардов общих). Она поддерживает рекордное контекстное окно в 10 миллионов токенов и работает даже на одной GPU H100 с квантизацией Int42. Это делает её идеальной для анализа больших данных, перевода редких языков и работы с методическими материалами. Согласно исследованиям Meta*, Scout превосходит Gemma 3, Gemini 2.0 Flash-Lite и Mistral 3.1 по широкому спектру бенчмарков.

Llama 4 Maverick

Maverick — более мощная версия с 17 миллиардами активных параметров и 128 экспертами (всего 400 миллиардов параметров). Эта модель превосходит GPT-4o и Gemini 2.0 Flash в задачах рассуждения и кодирования, при этом обладая вдвое меньшим количеством активных параметров. Её экспериментальная версия достигла ELO 1417 на LMArena. Maverick особенно эффективна для создания сложных AI-приложений, таких как преодоление языковых барьеров и творческое письмо.

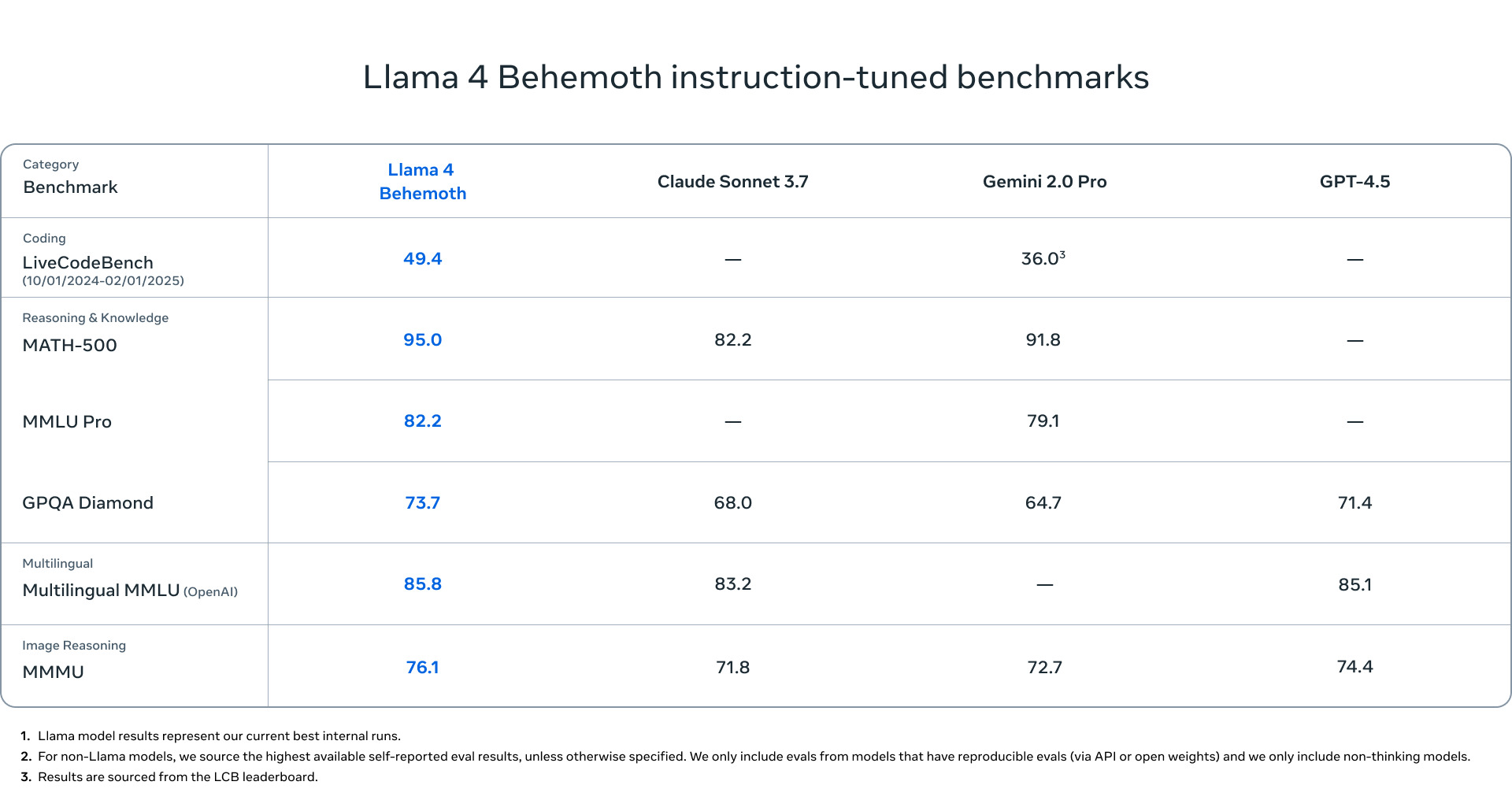

Llama 4 Behemoth

Behemoth — это учительская модель с 288 миллиардами активных параметров, 16 экспертами и почти 2 триллионами общих параметров. Хотя она всё ещё находится в процессе обучения, уже сейчас она превосходит GPT-4.5, Claude Sonnet 3.7 и Gemini 2.0 Pro по нескольким STEM-бенчмаркам3. Meta* планирует раскрыть больше технических деталей о Behemoth в будущем.

Технические инновации: MoE, раннее слияние и экстремально длинный контекст

Архитектура Mixture of Experts (MoE)

Впервые в линейке Llama используется архитектура MoE, где для обработки каждого токена активируется лишь часть параметров модели. Например, в Maverick каждый токен обрабатывается общим экспертом и одним из 128 маршрутизируемых экспертов. Это снижает вычислительные затраты и латентность при сохранении высокого качества.

Нативная мультимодальность

Модели используют раннее слияние для интеграции текстовых и визуальных токенов в единую архитектуру. Это позволяет совместно предобучать модель на больших объемах немаркированных текстовых, изображений и видеоданных. Визуальный энкодер основан на MetaCLIP, но обучен отдельно для лучшей адаптации к специфике языковой модели.

Экстремально длинный контекст

Scout поддерживает беспрецедентно длинный контекст в 10 миллионов токенов благодаря архитектуре iRoPE4 и масштабированию температуры внимания во время инференса. Это почти в 80 раз больше, чем у Llama 3, и открывает новые возможности для анализа больших массивов данных.

Новые методики обучения: FP8, метадистилляция и онлайн-RL

- FP8-precision:

Обучение с использованием 8-битной точности с плавающей запятой без потери качества. При обучении Behemoth достигнута производительность 390 TFLOPs/GPU с использованием 32K GPU. - Кодистилляция:

Behemoth используется как учитель для обучения меньших моделей. Новая функция потерь динамически взвешивает мягкие и жесткие цели в процессе обучения. - Полностью асинхронный онлайн-RL:

Новая инфраструктура для масштабного обучения с подкреплением обеспечивает 10-кратное улучшение эффективности обучения. Метафильтрация данных позволяет фокусироваться на сложных задачах, что значительно повышает точность модели в рассуждениях, кодировании и математике.

5. Безопасность и этика: новые стандарты

Meta* уделила особое внимание вопросам безопасности и снижению предвзятости в новых моделях:

- Разработаны открытые инструменты безопасности: Llama Guard, Prompt Guard и CyberSecEval.

- Внедрён новый метод тестирования — Generative Offensive Agent Testing (GOAT).

- Уровень отказов модели отвечать на вопросы о спорных политических и социальных темах снижен с 7% до менее 2%.

- Политическая предвзятость модели уменьшена до уровня, сравнимого с Grok (вдвое ниже, чем в Llama 3.3).

Доступность и применение: от исследований до бизнеса

Модели Llama 4 Scout и Maverick уже доступны для загрузки на llama.com и Hugging Face. Они также используются в сервисах Meta AI (WhatsApp, Messenger, Instagram Direct) и на сайте Meta.AI. Для разработчиков, предприятий и исследователей эти модели представляют собой золотую середину между высокой производительностью и доступностью по ресурсам.

Почему это важно?

Llama 4 — это не просто новая модель ИИ, а технологический скачок, который делает сложные технологии доступными для широкой аудитории. Она расширяет возможности для работы с многомодальными данными, открывает новые горизонты для приложений в различных сферах и создаёт экосистему, где узкоспециализированные "эксперты" заменят универсальные алгоритмы.

Заключение: будущее уже здесь

Llama 4 — это пример того, как искусственный интеллект может стать более доступным, безопасным и эффективным. Независимо от того, являетесь ли вы разработчиком, исследователем или просто любителем технологий, эта модель предлагает беспрецедентные возможности для творчества и решения задач. А вы готовы попробовать её в действии?

- Открытые веса — параметры модели, которые доступны для изучения, модификации и использования сторонними разработчиками.

- Квантизация Int4 — метод сжатия модели, при котором данные представлены с меньшей точностью, что снижает требования к вычислительным ресурсам.

- STEM-бенчмарки — тесты, оценивающие способности модели в решении задач, связанных с наукой, технологиями, инженерией и математикой.

- iRoPE — архитектура, использующая переплетённые слои внимания без позиционных эмбеддингов для обработки длинных последовательностей.

* Компания Meta (Facebook и Instagram) признана в России экстремистской и запрещена

Комментарии ()